A IA chegou às empresas. Agora falta chegar com responsabilidade

Durante muito tempo, a IA parecia mais uma promessa distante para as PMEs. Hoje já entrou na conversa, muitas vezes pela mão dos colaboradores mais curiosos, produtivos e impacientes. O desafio já não é perceber se a empresa vai usar IA, mas sim garantir que entra com governação, segurança e responsabilidade, e não pela porta das traseiras, empurrada por uma demo fantástica no Instagram.

Muitas empresas estão finalmente a acordar para a IA, não necessariamente por causa de uma decisão estratégica da administração, nem de um plano estruturado de transformação digital, mas por reboque desses colaboradores mais entusiastas. Pessoas que já usam ChatGPT, Claude, Gemini, Grok ou Perplexity fora da empresa e que chegam ao trabalho a pensar: “porque é que não posso usar isto aqui também?” Eu percebo-os bem, porque também sou um deles. Uso várias destas ferramentas, pago subscrições, testo modelos, comparo respostas e experimento funcionalidades novas. Sou tudo menos uma força do contra. A IA é provavelmente a maior oportunidade de produtividade que as empresas tiveram nos últimos anos.

O problema começa quando uma empresa começa a decidir como um consumidor.

Porque uma empresa não é um indivíduo. Uma empresa tem responsabilidades perante clientes, colaboradores, parceiros, fornecedores e reguladores. Tem contratos assinados, NDAs, informação comercial sensível, dados pessoais, segredos de negócio, reputação, risco financeiro, obrigações legais e RGPD. Aquilo que é aceitável no nosso uso pessoal pode não ser aceitável quando estamos a ligar uma plataforma externa ao coração da organização.

No caso de muitas empresas portuguesas, esse coração chama-se Microsoft 365.

É lá que estão os emails, documentos, reuniões, chats, ficheiros partilhados, propostas, mapas financeiros, minutas legais, conversas com clientes e histórico da empresa. E, de repente, por entusiasmo, por moda ou por pressão interna, começamos a querer ligar ferramentas externas de IA ao Microsoft 365 sem parar para pensar no essencial: que produtividade estamos a ganhar e que nova superfície de risco estamos a criar?

Porque podem ser as duas coisas ao mesmo tempo. Podemos ganhar produtividade e, simultaneamente, abrir uma nova porta de entrada que ninguém está a controlar.

Não é nada contra o Claude, nem contra o ChatGPT. A questão não é essa. A questão é arquitetura, governação e risco. A diferença entre escolher Copilot, Claude ou ChatGPT em contexto empresarial não está apenas na qualidade da resposta. Está também no sítio onde os dados são processados, nos controlos que existem, na forma como a identidade é gerida, na auditoria disponível, nas permissões concedidas e na capacidade real da empresa em governar a solução.

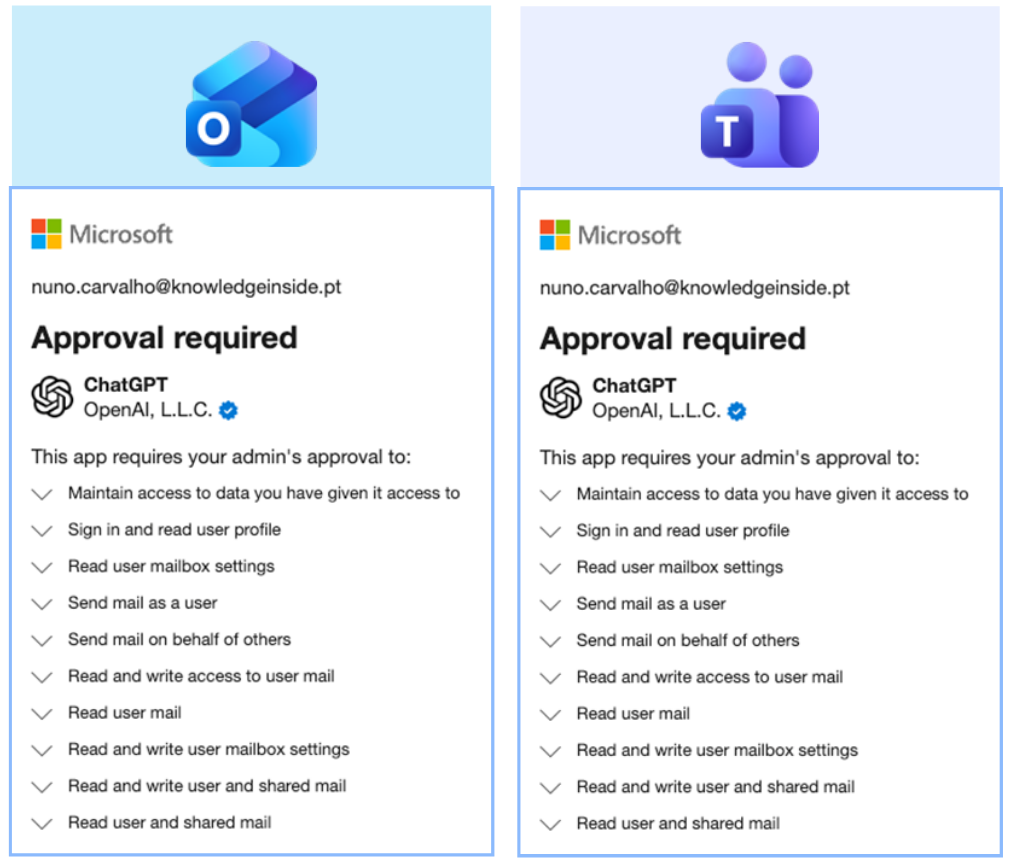

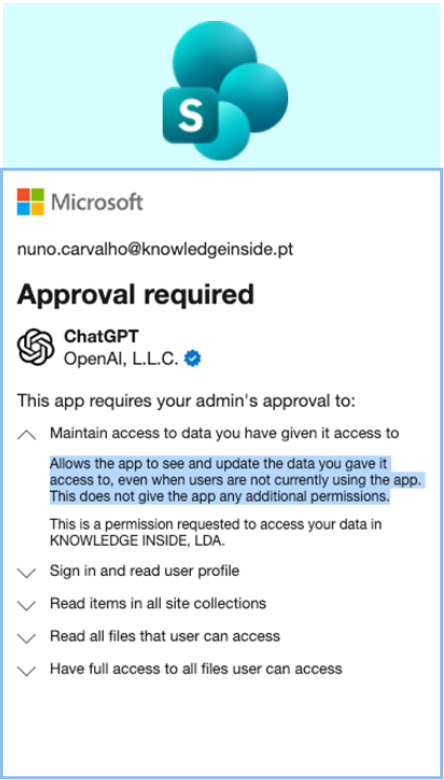

E é aqui que vale a pena olhar com atenção para aquelas janelas de autorização que quase toda a gente aceita sem ler. Quando ligamos uma aplicação externa ao Microsoft 365 através de OAuth, não estamos apenas a “entrar com a conta da empresa”. Estamos muitas vezes a autorizar uma aplicação registada a pedir acesso a emails, ficheiros, calendários, reuniões, chats ou dados de perfil, dependendo do conector e das permissões aprovadas.

A imagem que acompanha este artigo mostra precisamente isso: antes da magia da IA, há uma lista de permissões. E essa lista deve ser lida por alguém que perceba o que está a autorizar.

No caso do Claude, por exemplo, a própria Anthropic documenta que o conetor pode ser integrado com Microsoft Entra e respetivos controlos de segurança. Isto é positivo e é muito melhor do que integrações improvisadas. Mas “suporta controlos” não é o mesmo que “está seguro por defeito”. É preciso configurar, limitar, auditar e governar.

O Microsoft 365 Copilot (nao confundir com o Microsoft Copilot) tem aqui uma vantagem óbvia para organizações que já vivem no ecossistema Microsoft. Trabalha dentro do Microsoft 365, integrado com Microsoft Graph, Entra ID, Purview, SharePoint, Teams, Outlook e os controlos de segurança e compliance que muitas empresas já têm ou deveriam ter. A própria Microsoft posiciona o Copilot Control System como uma camada de gestão e governação para proteger dados sensíveis, mitigar riscos e aplicar políticas empresariais ao uso do Copilot.

Isto não significa que o Microsoft 365 Copilot seja magicamente seguro. Nenhuma ferramenta o é. Se a empresa tiver permissões mal definidas no SharePoint, ficheiros confidenciais partilhados com toda a organização ou falta de classificação da informação, o Copilot pode tornar esses problemas mais visíveis. Mas pelo menos a conversa acontece dentro do mesmo plano de controlo. E isso, numa PME, conta muito.

Porque muitas empresas não têm equipas grandes de segurança, nem departamento de compliance. Têm uma equipa pequena, um parceiro de IT e uma lista infinita de prioridades. Por isso, antes de ligar uma plataforma externa de IA ao Microsoft 365, convém fazer perguntas simples: quem pode aceder, que permissões são concedidas, se há SSO obrigatório, se as regras de Conditional Access se aplicam, se conseguimos exigir MFA e dispositivos compliant, se há logs, se há auditoria.

Há também outro ponto importante: a perceção que muitas pessoas têm do Microsoft 365 Copilot está desatualizada.

O Microsoft 365 Copilot já não é apenas “um ChatGPT dentro do Word”, nem um wrapper simples sobre um único modelo. Já disponibiliza ChatGPT 5.5 e Claude Opus 4.7 em cenários empresariais, com a própria Microsoft a confirmar a chegada do Claude Opus 4.7 ao Copilot Cowork, ao Researcher, ao Copilot Studio e ao Copilot no Excel.

Mais importante do que o nome dos modelos é a mudança de paradigma. No Researcher, o modo Council permite que a mesma pergunta seja analisada por agentes de raciocínio profundo baseados em GPT e Claude, preservando os relatórios de cada modelo e acrescentando uma síntese com convergências, divergências e contributos únicos. O Critique segue a mesma lógica multi-modelo: um modelo gera a primeira resposta e outro revê, critica e melhora o resultado antes da versão final.

Isto é muito diferente de perguntar “qual é o melhor LLM?”. A pergunta certa passa a ser: que combinação de modelos, contexto, dados internos, controlo e governação produz o melhor resultado para esta tarefa?

Para uma empresa que já usa Microsoft 365, isto muda a conversa da adoção. A discussão não deve começar pela IA mais trendy, mas pela forma mais segura, integrada e economicamente racional de pôr a IA a trabalhar dentro da empresa. Se o Microsoft 365 Copilot responder aos casos de uso, a empresa ganha produtividade dentro de uma arquitetura que já controla. Se não responder, então sim, deve avaliar o fornecedor mais adequado e implementar a coneção mas com planeamento, cautela e segurança.